这个项目还很不成熟,但是功能已经基本完成了。 用户需要熟悉 XML 和正则表达式。 目前该工具可用于抓取各种峰会、贴吧、各种CMS系统。 像 Discuz!、phpbb、论坛和博客这样的文章可以通过这个工具轻松捕获。 爬网定义完全采用 XML 格式,适合 Java 开发人员。

如何使用:

一侧下载.war包,导出到eclipse中。

使用 WebContent/sql 下的 wcc.sql 文件构建示例数据库。

修改src包下wcc.core的dbConfig.txt,将用户名和密码设置为自己的mysql用户名和密码。

然后运行SystemCore。 运行时会显示控制台。 如果没有参数,将执行默认的example.xml配置文件。 如果有参数,则名称为配置文件名。

系统自带了三个例子,分别是baidu.xml(抓取百度知道)、example.xml(抓取我的javaeye博客)、bbs.xml(抓取discuz峰会的内容)。

特点:通过 XML 配置文件进行高度可定制和可扩展

12.蜘蛛侠

Spiderman是一款基于微内核+插件架构的网络蜘蛛。 其目标是以简单的方式捕获复杂的目标网页信息并将其解析为它需要的业务数据。

如何使用?

首先确定你的目标网站和目标网页(即你想要获取数据的某类网页,比如网易新闻的新闻页面)

然后,打开目标页面,分析该页面的HTML结构,并获取所需数据的XPath。 请参阅下文了解如何获取 XPath。

最后,在xml配置文件中填写参数并运行Spiderman!

特点:灵活、扩展性强,微内核+插件架构,无需编写一行代码,通过简单配置即可完成数据采集

13. 网络魔法

webmagic是一个爬虫框架,无需配置,方便二次开发。 它提供了简单灵活的API,只需少量代码即可实现爬虫。

webmagic采用完全模块化设计,功能覆盖整个爬虫生命周期(链接提取、页面下载、内容提取、持久化),支持多线程爬取、分布式爬取,支持手动重试、自定义UA/Cookies等功能。

Webmagic 包含强大的页面提取功能。 开发者可以方便地使用CSS选择器、xpath和正则表达式来提取链接和内容,并支持多个选择器的链式调用。

webmagic使用文档:

查看源代码:

特点:功能覆盖整个爬虫生命周期,使用Xpath和正则表达式提取链接和内容。

注:这是黄一华贡献的国产开源软件

14. 网络收获

Web-Harvest是一个Java开源Web数据提取工具。 它可以收集指定的网页并从这些网页中提取有用的数据。 Web-Harvest主要利用XSLT、XQuery、正则表达式等技术来实现text/xml操作。

实现原理是使用httpclient根据预定义的配置文件获取页面的全部内容(本博客有的文章已经介绍了httpclient的内容),然后利用XPath、XQuery、正则表达式等技术实现text/xml内容过滤操作,选择准确的数据。 近两年流行的垂直搜索(如酷讯等)也是采用类似原理实现的。 对于Web-Harvest应用程序来说,关键是理解和定义配置文件,剩下的就是考虑如何处理数据的Java代码。 当然,在爬虫启动之前,也可以将Java变量填充到配置文件中,实现动态配置。

特点:使用XSLT、XQuery、正则表达式等技术操作Text或XML,具有可视化界面

15.WebSPHINX

WebSPHINX 是 Java 类包和网络爬虫的交互式开发环境。 网络爬虫(也称为机器人或蜘蛛)是可以手动浏览和处理网页的程序。 WebSPHINX由两部分组成:爬虫工作平台和WebSPHINX类包。

许可合同:Apache

开发语言:Java

特点:由爬虫工作平台和WebSPHINX类包两部分组成

16. 亚西

YaCy是一个基于p2p的分布式网络搜索引擎。 它也是一个Http缓存代理服务器。 该项目是一种基于p2p建立Web索引网络的新技术。 它可以搜索自己的或全局的索引,也可以爬行自己的网页或开始分布式爬行等。

特点:基于P2P的分布式Web搜索引擎

Python爬虫17、QuickRecon

QuickRecon 是一个简单的信息收集工具,可以帮助您查找子域名、执行区域传输、收集电子邮件地址以及使用微格式查找关系。 QuickRecon是用python编写的,支持linux和windows操作系统。

功能:功能包括查找子域名、收集电子邮件地址、查找人际关系。

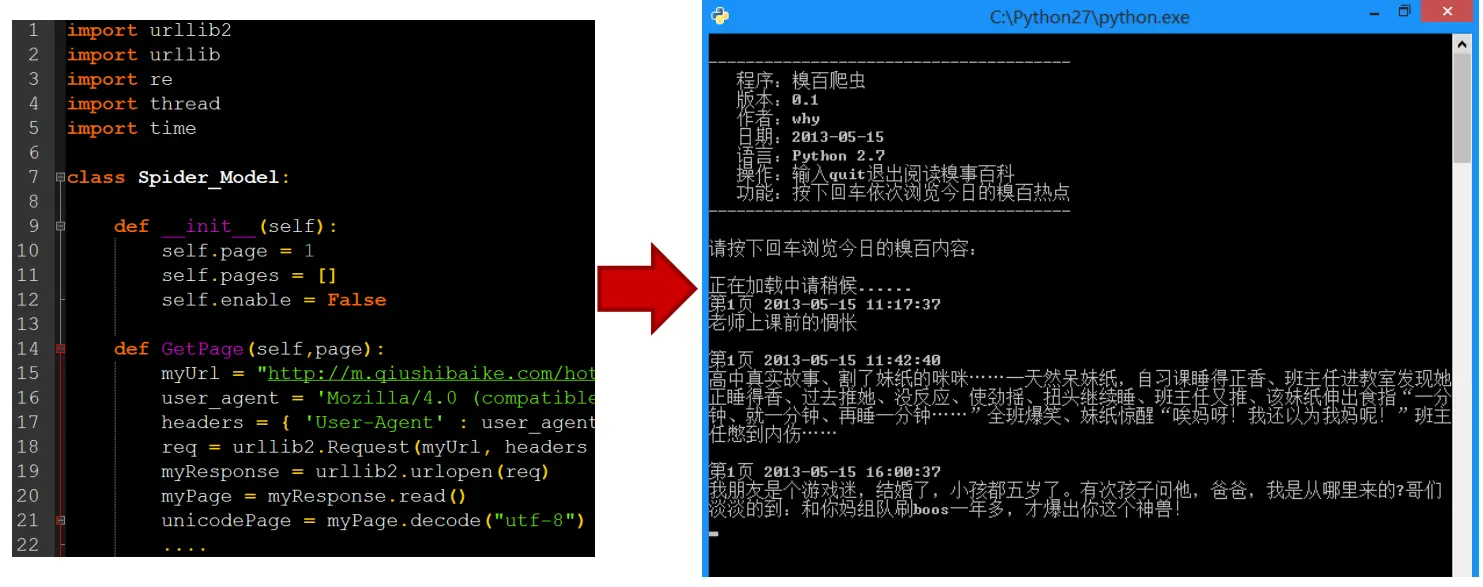

18.PyRailgun

这是一个非常简单易用的抓取工具。一个简单、实用、高效的python网络爬虫爬虫模块,支持抓取javascript渲染的页面

特点:简单、轻量、高效的网络爬虫框架

注:这个软件也是中国人打开的

github 下载:#readme

19. Scrapy

Scrapy是一个基于Twisted的异步处理框架,用纯Python实现的爬虫框架。 用户只需要定制和开发几个模块,就可以轻松实现一个爬虫来爬取网页内容和各种图像。 非常方便。 〜

github源代码:

特点:基于Twisted的异步处理框架,文档齐全

C++爬虫20、hispider

HiSpider是一款快速、高性能的蜘蛛,速度快

严格来说,它只能是一个蜘蛛系统框架。 无需细化。 目前只能提取URL、URL去重、异步DNS解析、队列任务、支持N机分布式下载、支持网站定向下载(需要配置hispiderd.ini白名单)。

特点及用途:

工作过程:

许可合同:BSD

开发语言:C/C++

操作系统:Linux

特点:支持多机分布式下载,支持网站定向下载

21. 拉宾

Larbin是由美国年轻人Sébastien Ailleret独立开发的开源网络爬虫/网络蜘蛛。 larbin的目的是跟踪页面的url以进行扩展爬行,最终为搜索引擎提供广泛的数据源。 Larbin只是一个爬虫,也就是说larbin只爬取网页,解析由用户来完成。 另外,larbin没有提供如何将其存储在数据库中以及如何改进索引的信息。 一个简单的 larbin 爬虫每晚可以获取 500 万个网页。

使用larbin,我们可以轻松获取/确定单个网站的所有链接,甚至镜像一个网站; 我们还可以用它来完成URL列表分组,比如对所有网页进行url检索,然后获取xml链接。 无论是 mp3,还是定制的 larbin,都可以用作搜索引擎的信息源。

特点:高性能爬虫软件,只负责爬取,不解析

22.Methabot

Methabot 是一款速率优化、高度可配置的爬虫软件,适用于 WEB、FTP 和本地文件系统。

特点:超速优化,能够爬取WEB、FTP和本地文件系统

源代码:

C#爬虫23、NWebCrawler

NWebCrawler是一个开源的、C#开发的网络爬虫程序。

特征:

许可合同:GPLv2

开发语言:C#

操作系统:Windows

项目主页:

特点:统计信息、执行过程可视化

24. 西纳勒

国内首个针对微博数据的爬虫程序! 前身为“新浪微博爬虫”。

登录后,您可以指定用户为起点,以用户的关注者和粉丝为线索,通过人脉关系收集用户的基本信息、微博数据、评论数据。

本应用获得的数据可作为科学研究、新浪微博相关开发等的数据支撑,但不得用于商业目的。 该应用基于.NET2.0框架,需要SQL SERVER作为后台数据库,并为SQL Server提供数据库脚本文件。

另外,由于新浪微博API的限制,爬取的数据可能不完整(如获取粉丝数限制、获取微博数限制等)

本程序的版权归作者所有。 您可以自由地:复制、分发、展示和表演当前作品以及制作衍生作品。 您不得将当前作品用于商业目的。

5.x版本已经发布! 该版本共有6个后台工作线程:爬取用户基本信息的机器人、爬取用户关系的机器人、爬取用户标签的机器人、爬取微博内容的机器人、爬取微博评论的机器人以及调整请求频率机器人。 更好的性能! 最大限度地发挥爬行动物的潜力! 从今天的测试结果来看,个人使用已经足够了。

该程序的特点:

6 个后台工作线程,最大限度地发挥爬虫性能潜力!

提供界面参数设置,灵活方便

放弃app.config配置文件,自行实现配置信息加密存储,保护数据库账号信息

自动调整请求频率公司网站模板源码下载软件,防止超限、减慢,降低效率

任意控制爬虫,可以随时暂停、继续、停止爬虫

良好的用户体验

许可合同:GPLv3

开发语言:C#.NET

操作系统:Windows

25. 蜘蛛网

Spidernet 是一个以递归树为模型的多线程网络爬虫程序。 支持text/html资源的获取。 可设置爬取深度、最大下载字节限制,支持gzip解码,支持gbk(gb2312)和utf8编码。 资源; 存储在 sqlite 数据文件中。

源代码中的TODO:标记描述了未完成的功能,希望提交您的代码。

github源代码:

特点:以递归树为模型的多线程网络爬虫程序,支持GBK(gb2312)和utf8编码的资源,使用sqlite存储数据

26. 网络爬虫

mart和Simple Web Crawler是一个网络爬虫框架。 集成 Lucene 支持。 爬虫可以从单个链接或链接字段开始,提供两种遍历模式:最大迭代次数和最大深度。 您可以设置过滤器来限制爬回的链接。 默认情况下,提供了三个过滤器:ServerFilter、BeginningPathFilter 和 RegularExpressionFilter。 这三个过滤器可以通过 AND、OR 和 NOT 进行组合。 可以在解析过程中或页面加载前后添加监听器。 介绍内容来自Open-Open

特点:多线程,支持抓取PDF/DOC/EXCEL等文档源

27. 网络矿工

网站数据采集软件 Network Miner Collector(原Soukey Picking)

Soukey Picking网站数据采集软件是一款基于.Net平台的开源软件,也是网站数据采集软件类型中唯一的开源软件。 Soukey虽然选择开源,但并不影响软件功能的提供,甚至比一些商业软件还要丰富。

特点:功能丰富,不逊于商业软件

PHP爬虫28、OpenWebSpider

OpenWebSpider 是一个开源的多线程网络蜘蛛(机器人:robot,爬行器:crawler)和一个包含许多有趣功能的搜索引擎。

特点:开源多线程网络爬虫,具有许多有趣的功能

29.PhpDig

PhpDig是一个用PHP开发的网络爬虫和搜索引擎。 通过索引动态和静态页面来构建词汇表。 当搜索查询时,它会按照一定的排序顺序显示包含关键字的搜索结果页面。 PhpDig 包括一个模板系统,可以索引 PDF、Word、Excel 和 PowerPoint 文档。 PHPdig适合更专业、更深入的个性化搜索引擎。 用它来构建某个领域的垂直搜索引擎是最好的选择。

演示:

特点:具有采集网页内容、提交表单的功能

30.思考

ThinkUp是一款社交媒体透视引擎,可以收集Facebook、facebook等社交网络数据。 一种交互式分析工具,可以从个人社交网络帐户收集数据公司网站模板源码下载软件,对其进行存档和处理,并将数据绘制成图表以便更直观地查看。

github源代码:

特点:社交媒体透视引擎,采集Facebook、Facebook等社交网络数据,可以进行交互分析,并以可视化的方式解读结果

31.微购

微商社交购物系统是一个基于ThinkPHP框架开发的开源购物分享系统。 也是一款面向站长的开源淘宝建站程序。 整合了天猫、天猫、淘宝等300个网站。 多种商品数据采集插座,为淘宝站长提供白痴式的淘宝建站服务。 如果他们了解 HTML 并且免费开放下载,他们就可以制作程序模板。 是淘宝站长的首选。

演示网址:

许可合同:GPL

开发语言:PHP

操作系统:跨平台

ErLang爬虫32、Ebot

Ebot是一个用ErLang语言开发的可扩展的分布式网络爬虫。 URL 保存在数据库中,可以通过 RESTful HTTP 请求进行查询。

github源代码:

项目主页:

特点:可扩展的分布式网络爬虫

Ruby爬虫33、Spidr

Spidr是一个Ruby网络爬虫库,可以完全抓取整个网站、多个网站以及本地的链接。

特点:本地可完整抓取一个或多个网站及某个链接

本文由36个大数据收集整理