松鱼羊来自奥飞寺

量子比特|公众号QbitAI

什么样的新技术能够在ChatGPT的圈子里脱颖而出并受到观众的欢迎?

一部iPhone,两分钟,真人变成数字人!

也是一一还原动态表情和眼神细节的一款。

没错,发布会的动作捕捉视频、iPhone录制以及整个后期处理过程都是在现场完成的。

此前,《地狱之刃》中女明星的动作捕捉经验都是由姜阿姨完成的:

复杂的设备必不可少,但除了标记出车身上的所有定位点外,后期处理时间也将需要数周甚至数月的时间。

这不,Epic刚刚公布了虚幻引擎5的新能力动作捕捉网站源码下载,网友们都快疯了,相关视频观看量迅速突破百万。

至于“现场”气氛,概括起来就是操作猛如虎。 网友纷纷惊呼太疯狂了:

(实现面部建模)从几个月到几分钟,未来几年游戏的发展必然是疯狂的。

有网友表示,现在已经不能说自己的所见哪一个是真实的了。

三帧视频即可生成3D模型

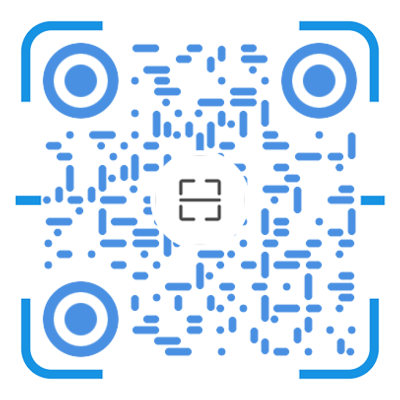

具体来说,我们来看看这个名为“MetaHumanAnimator”的炫酷操作是如何在两分钟内实现背部动作捕捉的。

以现场演示为例。 首先,艺术家要录制一段视频,在视频中他可以做出任何表情。 可以夸大愤怒:

也可能是视力的微小变化:

但整个录制过程只需要一部iPhone。

之后,技术人员将录制的视频上传到软件中,整个处理过程在本地进行。

总结一下,处理过程分为两步:

1. 最新版本的LiveLinkFace应用程序将以尽可能最佳的帧速率捕捉所有面部动态;

2. MetaHumanAnimator使用视频和Dev数据将其转换为高保真动画。

在这个过程中,LiveLinkFace首先被用来捕捉艺术家视频中的面部动作。

完成面部捕捉后,只需要三帧视频(前、左、右)即可生成艺术家的“超人类DNA”。

使用的算法是后向特征算法的定制版本,生成过程只需几秒钟。

这样,所有的后台数据都会被校准,更容易还原刚才视频录制中的面部表情。

更重要的是,在此过程中,真人视频可以与生成的建模视频进行逐帧比较。

几分钟之内,完整的动画视频就成功生成了。 最后,工作人员要做的就是微调并导出音频。

在新应用程序的支持下,工作人员可以轻松实现如右图所示的治疗效果。

在算法细节方面,Epic使用自己的“面部解算器”和“标记检查器”来确定视频中人物面部的关键操作点。

借助这些关键点,基于语义空间解决方案,人工智能会将每个视频帧映射到“n维人类空间”数据库中其最近的邻居。

这个所谓的“n维人体空间”,是Epic根据多年来收集的详细面部捕捉数据打磨出来的一个庞大数据库,其中包括腹部各个部位的各种运动姿势。

网友:3D动画和游戏即将改变

Epic的这一波爆款,给最近被AI大浪潮发呆的人类增添了一丝兴奋。

超人领域网友表示“3D动画和游戏即将改变”:

几个月前,使用 iPhone 只能粗略地控制背部和胸部肌肉。

不过,相比各种“失业”场景,更多人乐于看到这项技术的成果。

有网友表示,有了这项技术,开发者的效率可以直接提升一倍动作捕捉网站源码下载,节省大量时间。 需要做的就是后期制作打磨。

一些网友已经开始期待电影制片人使用这项技术:

Epic 自己表示,新的 MetaHumanAnimator 有助于“复杂角色技术的民主化”。 该公司表示,这项新技术预计将在明年春天得到更广泛的应用。

那么,你期待吗?

参考链接:

[1]

[2]

[3]

-超过-

量子比特QbitAI·今日头条签约协议

关注我们,第一时间了解前沿技术动态