网络爬虫是一种按照一定规则自动抓取万维网数据的脚本。 按照一定的规则,意味着爬虫程序需要解析网页的DOM结构,并根据DOM结构爬取自己感兴趣的数据。

(图1)

这是一个网页源代码的DOM结构。 我们需要逐级指定捕获的标签,如下所示:

(图2)

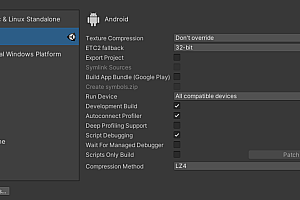

图2是java程序使用webmagic框架开发的爬虫程序。 这段代码是抓取对应的标签,对应图1,运行后结果如下:

当然,以上是专业程序员所做的事情,但它有助于我们了解爬虫工具的工作原理。 非专业人士可以通过爬虫工具自行爬取数据。

1、首先输入您要抓取的网站网址,点击“开始采集”。

2、工具手动识别当前页面为多页数据,默认会翻页采集。 我们只需要点击“生成集合设置”即可。

3.点击需要收集的详细链接。 这里我们要收集本网站所有化工产品的信息,所以点击英文名称一栏的一个链接游戏源码抓取,然后点击旁边的“点击链接”,如右图所示

4、爬虫工具进入带有详细链接的页面。 这个页面的数据就是我们要爬取的。 点击“生成集合设置”,生成爬虫工具最终的爬取流程。 如下图所示,爬虫工具会根据这个过程为我们收集数据,直到数据收集完成。

5、点击“收集”按钮,爬虫工具开始运行。 爬虫工具的工作原理如下:

列表中的数据都是爬虫收集的。 我们还可以处理收集到的数据。 您可以选择导入到Excel文档或直接导出到数据库。 这些是后续分析数据和进一步处理数据的必要条件。 有了这样的基础数据,就可以对数据进行分析,得到一些业务依据,作为业务决策的支持。 比如,家乐福曾经利用他们的大数据发现,买尿布的爸爸们喜欢一起买饮料游戏源码抓取,于是他们把尿布和饮料放在一起,啤酒的销量大增。 这就是大数据的价值。

这次讨论的爬虫工具的使用只是比较基础的应用。 希望对您有所帮助。 科技汇威带您探索科技。 后续我们将持续更新相关知识。 欢迎关注。